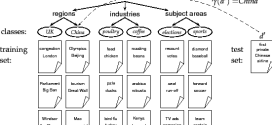

توجه شود که در يک مسئله دستهبندي ابتدا بايد هر سند موجود در مجموعه آموزشي داده شده را در متغير مناسبي ذخيره کرد و نام دسته آن سند را که با مشخصه اي خاص مثلا نام سند بدست آورد و سپس تمام توکنهاي سند استخراج و در محل مناسبي ذخيره گردد .حال کلمات توقف را حذف ميشود. چون اين کلمات توقف در هر زبان ثابت هستند در نتيجه اين کلمات را در يک فايل ذخيره ميکنيم وسپس توکنهاي بدست آمده از متن را با محتواي اين متن مقايسه ميکنيم و در صورت تساوي آنها را حذف ميکنيم. بردار نام برده شده در بالا براي ذخيره سازي متن شامل خصوصيات ميباشد. حال ممکن است داده ها را به دو قسمت تقسيم کنيم که مجموعه اول به عنوان مجموعه آموزشي ومجموعه دوم به عنوان مجموعه آزمايشي به مرحله بعدي تحويل داده ميشود. توجه شود که مجموعه آموزشي نسبت به مجموعه آزمايشي بزرگتر باشد. به اين دليل از همين داده ها به عنوان مجموعه آزمايشي استفاده ميکنيم که گروه اين کلاس ها مشخص است و ميتوان نتيجه بدست آمده را مقايسه کرد ومجموعه آموزشي را تاييد نمود.

در مرحله بعد يکي ازالگوريتم هاي يادگيري را اجرا کرده و مدلي براي تشخيص دسته اسناد جديد ايجاد ميکنيم. توجه شود که با تغيير دادن مجموعه آزمايشي و آموزشي ميتوان يک ارزيابي از متن داده شده براي آموزش والگوريتم يادگيري بدست آورد.

1-1 تئوري بيز[1]

در يادگيري ماشين[2] اغلب علاقه مند هستيم که در فضاي H بهترين فرضيه را از آموزش داده ها بدست آوريم. مجموعه H در مسئله دستهبندي شامل تمام فرضيه ها که همان گروه هاي معرفي شده براي دستهبندي هستند، ميباشد. تئوري بيز يک روش مستقيم براي محاسبه احتمال را فراهم ميکند يا به عبارت ديگر يک راه به منظور محاسبه احتمال يک فرض يا يک گروه که اساس آن روي احتمالات قبلي ميباشد، فراهم ميکند.

قبل از معرفي تئوري بيز اجازه دهيد تا چند نکته را بيان کنم. P(h) را براي بيان احتمال اوليه فرضيه h معرفي ميکنيم. که اغلب P(h) را احتمال قبلي[3]h مينامند و ممکن است هر دانش پس زمينه منعکس شده ما، درباره شانس آن h در فرضيه جاري باشد.اگر ما هيچ دانش قبلي نداشته باشيم ، ما به سادگي يک مقدار احتمال قبلي را به هر شرايط فرضيه نسبت ميدهيم. به طور مشابه ما P(D) را براي داده هاي آموزش ديده معرفي ميکنيم. بعد P(D|h) احتمال داده D به شرط فرضيه h را بيان ميکند.

همان طور که از فرمول مشخص ميباشد با افزايش P(D|h) و P(h) مقدار P(h|D) افزايش و با افزايش P(D) مقدار P(h|D) کاهش مييابد.

در بسياري از سناريوهاي آموزشي ، يادگيرنده تعدادي فرضيه کانديد شده در مجموعه H را بررسي ميکند و علاقه مند است تا بيشترين احتمال داده D را در فرضيه h عضو مجموعه H را بدست آورد يعني احتمال اينکه متن داده شده براي Test عضو يک فرضيه يا گروه h باشد را بدست ميآورد و فرضيه اي را که داراي احتمال بيشتر ميباشد را در نظر ميگيرد. هر احتمال بيشينه را بيشينه قياسي[4]مينامند. ما ميتوانيم فرضيه MAP را با به کار بردن تئوري بيز براي هر احتمال بعدي[5] براي هر فرضيه بدست ميآيد.

به عبارت ديگر:

توجه شود که مرحله نهايي P(D) را به علت مستقل بودن آن از h از مخرج فرمول فوق حذف ميکنيم. توجه شود که P(D) براي همه فرضيه يکسان ميباشد.

[1]Bayesian theory [2]Machine Learning [3]Prior Probability [4]Maximum A Posteriori [5]Posterior

فهرست مطالب

1- دسته بندي…. 3

1-1 مقدمه 3

1-2 تئوري بيز 5

2-2-1تئوري بيز و يادگيري مفهومي 8

2-2-2يادگيري مفهومي 8

2-2-3دسته کننده بيزي ساده 9

1-3 پياده سازي نرم افزاري 19

تعاونی نیرومندسازی تحقیقات جامع ترین مرجع دانلود تحقیق، مقاله، سمینار و پایان نامه

تعاونی نیرومندسازی تحقیقات جامع ترین مرجع دانلود تحقیق، مقاله، سمینار و پایان نامه